La nuova concessione per il gioco online introduce tra gli elementi più rilevanti l’adozione, da parte dei concessionari, di sistemi di analisi comportamentale finalizzati alla prevenzione del gioco problematico, segnando un possibile cambio di paradigma nelle politiche di tutela del giocatore. Lo evidenzia uno studio della Fondazione Fair.

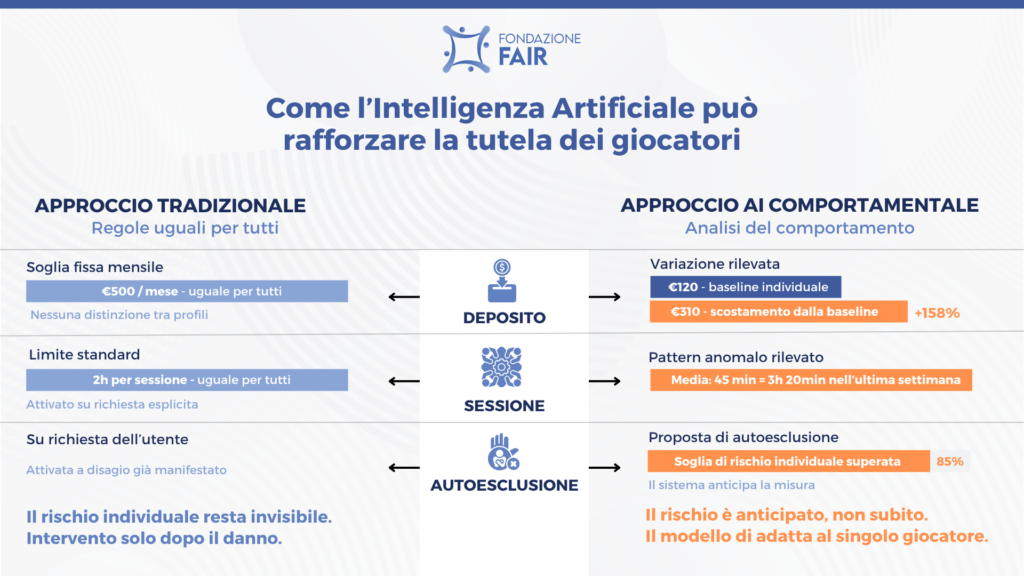

Finora, le misure di gioco responsabile si sono basate soprattutto su strumenti standardizzati, come limiti di deposito, di tempo o di spesa, autoesclusione e messaggi informativi uguali per tutti. Presìdi considerati necessari, ma spesso giudicati poco flessibili e incapaci di cogliere con tempestività i segnali iniziali di rischio.

Il nuovo approccio punta invece a osservare il comportamento del singolo giocatore nel tempo, superando la logica delle soglie fisse. In questo quadro, l’intelligenza artificiale viene indicata come un fattore decisivo di evoluzione, grazie alla capacità di elaborare grandi quantità di dati e individuare variazioni anche minime nelle abitudini di gioco, dalla frequenza delle sessioni alla durata, dai depositi alla spesa, fino agli orari di attività.

L’impatto pratico dell’intelligenza artificiale

L’obiettivo non è soltanto migliorare la capacità predittiva, ma rendere possibili interventi più tempestivi, proporzionati e personalizzati. In questa prospettiva, anche strumenti di nudging, come alert contestualizzati, inviti alla riflessione sul proprio comportamento, suggerimenti per impostare limiti volontari o pause temporanee, potrebbero risultare più efficaci rispetto alle tradizionali comunicazioni generaliste.

Il punto centrale, secondo l’analisi della Fondazione Fair, è la possibilità di intervenire prima che il comportamento diventi apertamente problematico. Un sistema avanzato potrebbe infatti cogliere combinazioni di segnali deboli che, presi singolarmente, non indicherebbero ancora una condizione critica, ma che nel loro insieme potrebbero rappresentare un campanello d’allarme utile ai fini preventivi.

Questi modelli potrebbero diventare ancora più robusti se integrati con evidenze della ricerca scientifica e strumenti di valutazione del rischio già utilizzati in ambito psicologico e comportamentale, come il PGSI, rafforzando così il legame tra tecnologia e conoscenza specialistica.

Resta però aperto il nodo della governance. La stessa tecnologia, infatti, può essere usata sia per proteggere il giocatore sia per aumentare coinvolgimento e monetizzazione. Per questo, il vero tema non viene considerato solo tecnologico, ma anche regolatorio: sarà decisivo chiarire chi definisce gli indicatori di rischio, con quali priorità e sotto quale controllo.

Da qui la necessità di definire linee guida condivise, criteri omogenei e strumenti di accountability in grado di valutare non solo l’esistenza dei sistemi, ma anche il loro impatto concreto. La sfida, in definitiva, è trasformare il gioco responsabile da semplice obbligo normativo a leva di sostenibilità industriale, reputazionale e sociale. sm/AGIMEG